自2010年代以来,人工智能(AI)技术飞速发展,现已渗透到我们日常生活的各个领域。如今,AI不仅预装在家用电器和智能手机中,甚至在近几年被用于自动驾驶技术。然而,AI真的足够安全吗?2023年,对话式AI和聊天机器人的快速崛起引发了广泛关注,其威胁不仅局限于取代现有的工作岗位,甚至可能对人类生命构成潜在威胁。如何应对AI带来的风险,已成为全球关注的焦点课题。为此,我们专访了知名人工智能专家吉川雅弥教授,就“AI与安全”这一紧迫议题进行了深入探讨。

AI相关的四大安全挑战

在讨论人工智能与安全问题时,目前有四大关键挑战。首先是“欺骗AI”现象。例如,自动驾驶汽车依赖安装的摄像头识别路标并做出反应。当车辆遇到“停车”标志时,它会自动停下。然而,如果对标志的部分细节进行微小的修改,这些改变在人类眼中可能无关紧要,但足以使自动驾驶系统无法正确识别,从而导致潜在的交通事故,例如与迎面而来的车辆发生碰撞。

在讨论人工智能与安全问题时,目前有四大关键挑战。首先是“欺骗AI”现象。例如,自动驾驶汽车依赖安装的摄像头识别路标并做出反应。当车辆遇到“停车”标志时,它会自动停下。然而,如果对标志的部分细节进行微小的修改,这些改变在人类眼中可能无关紧要,但足以使自动驾驶系统无法正确识别,从而导致潜在的交通事故,例如与迎面而来的车辆发生碰撞。

其次,自动驾驶汽车依赖“测距传感器”来计算车距。该传感器通过发射激光并根据光线返回的时间来测量距离。但如果外部干扰者发出虚假脉冲,改变光线的传播路径,就可以篡改传感器的测量结果,进而影响车辆的决策。这种通过操控外部数据干扰AI判断的行为,已经成为AI系统安全面临的重大挑战之一。

第二个问题是如何保护AI免受旁路攻击的威胁。旁路攻击利用物理信息,例如电力消耗、电磁辐射和处理时间等,推测出AI系统内部的数据和加密密钥。通过持续监测AI在决策过程中的电力消耗和电磁辐射,攻击者有可能推测出其内部信息。这种攻击方式可能导致AI的内部机密信息被窃取,甚至遭到非法复制。为了防止此类信息泄露,必须采取措施,切断AI内部数据与外部物理信息之间的关联。

第三个问题是如何保护AI的训练数据。据研究表明,攻击者可以通过分析AI的输出结果,推测出其训练数据的来源。这在医疗领域尤为令人担忧,AI常常处理患者病历等高度敏感的隐私信息。如果这些数据被推测或泄露,可能导致个人隐私被侵犯。因此,确保AI的输出不会暴露其训练数据成为关键的安全防护措施。

最后,第四个问题是防止AI的训练数据遭到污染。攻击者可能通过“投毒攻击”篡改AI的训练数据,导致AI在实际应用中做出错误的判断。近年来,已有大量此类攻击事件被报道,说明这种威胁在现实中正在不断增加。

保护AI免受恶意攻击者的威胁

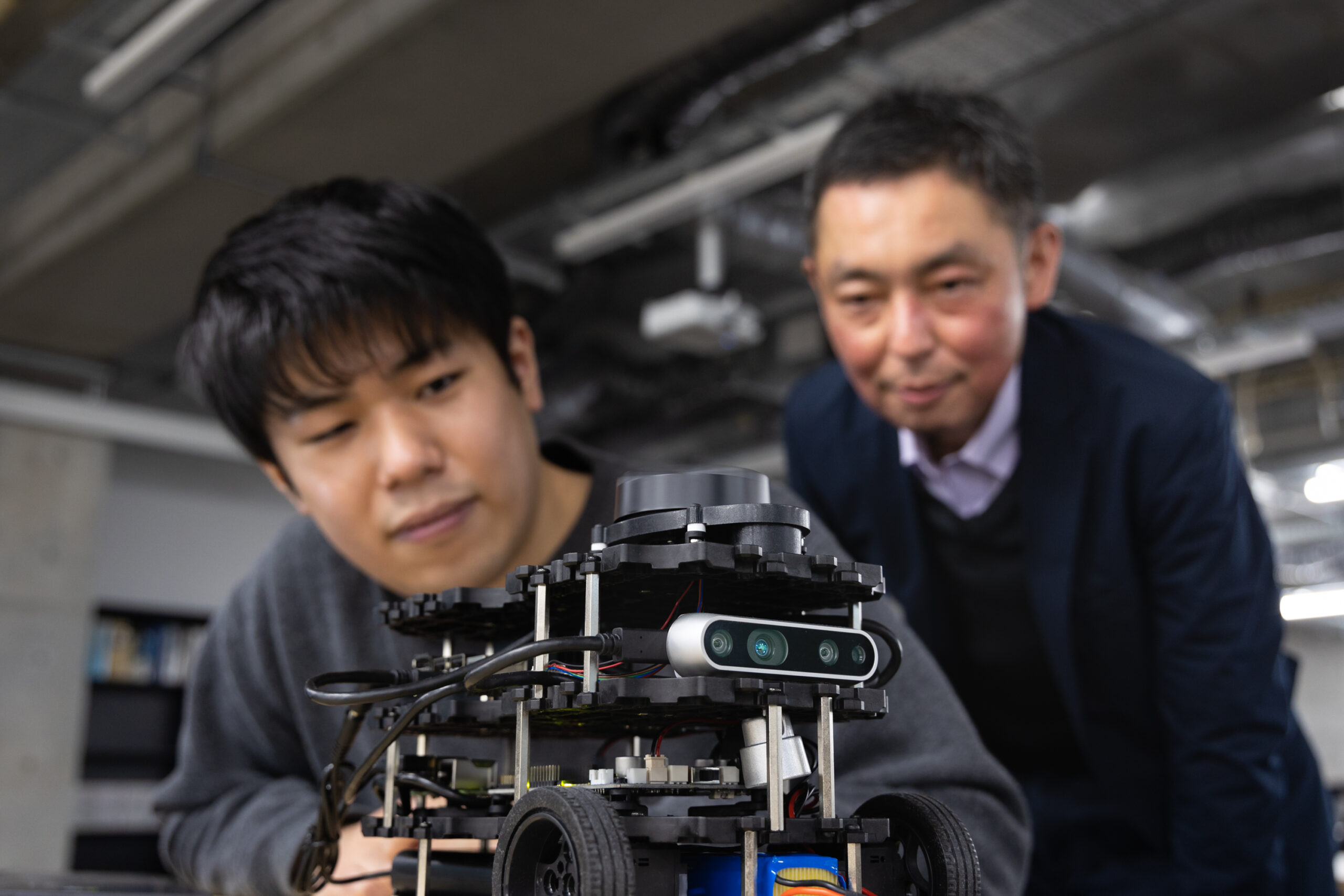

未来,人工智能(AI)将广泛应用于各个领域,并与多种技术进行跨领域融合,呈现出“AI×〇〇×□□”的多样化发展趋势。作为硬件安全领域的专家,我目前专注于通过“AI×安全”“AI×安全×硬件”等创新组合,研究如何保护AI系统免受恶意攻击。这一领域虽刚刚起步,但随着AI在现实社会中的广泛应用,确保其安全性无疑将成为未来发展的关键。

未来,人工智能(AI)将广泛应用于各个领域,并与多种技术进行跨领域融合,呈现出“AI×〇〇×□□”的多样化发展趋势。作为硬件安全领域的专家,我目前专注于通过“AI×安全”“AI×安全×硬件”等创新组合,研究如何保护AI系统免受恶意攻击。这一领域虽刚刚起步,但随着AI在现实社会中的广泛应用,确保其安全性无疑将成为未来发展的关键。

随着越来越多的工作交由AI完成,“AI是否值得信任”这一问题变得愈发重要。特别是用于自动驾驶和面部识别等与人身安全密切相关的AI技术,任何系统漏洞或错误都可能引发社会恐慌。此外,黑客可能在毫无察觉的情况下,窃取AI系统中的宝贵信息,进一步加剧了这一威胁。

攻击者可以利用各种信息,从不同角度瞄准系统的薄弱环节发起攻击。只要恶意行为者存在,安全问题就不可能彻底消除。因此,确保AI的安全性是一项持久的挑战。为了应对这一挑战,我们高校的责任是未雨绸缪,提前规划未来5至10年的安全策略,推动相关研究和技术的发展,以保障AI的安全性和社会信任度。

【采访日期】2021年1月22日